Коллайдер (статистика)

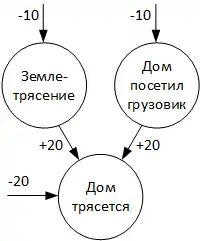

Коллайдер (англ. collider) — переменная в статистике и причинно-следственных диаграммах, на которую влияют две или более переменных. Название «коллайдер» отражает тот факт, что в графических моделях стрелки от переменных, ведущие в коллайдер, «сталкиваются» в узле, который является коллайдером[1]. Иногда коллайдеры также называют перевёрнутыми вилками[2].

.png.webp)

Причинные переменные, которые влияют на коллайдер, не обязательно связаны между собой. Если они не связаны между собой, коллайдер не защищён. В противном случае коллайдер защищён и является частью треугольника (см. рисунок)[3].

Если на пути есть коллайдер, то он блокирует связь между переменными, которые на него влияют[4][5][6]. Таким образом, коллайдер не создаёт безусловной связи между влияющими на него переменными.

Учёт коллайдера в условиях задачи с помощью регрессионного анализа, стратификации, экспериментального дизайна или выборки на основе значений коллайдера создаёт ложную причинную связь между X и Y (парадокс Берксона). Выражаясь терминологией причинных графов, учёт коллайдера открывает путь между X и Y. Это влечёт за собой системную ошибку при оценке причинно-следственной связи между X и Y, вводя причинную связь там, где её нет. Следовательно, коллайдеры могут негативным образом повлиять на проверку причинной теории.

Коллайдеры иногда путают со спутывающими переменными. В отличие от коллайдеров, спутывающие переменные необходимо учитывать при оценке причинно-следственных связей.

См. также

- Причинный граф

- Ориентированный ациклический граф

- Анализ пути

Примечания

- Hernan, Miguel A. & Robins, James M. (2010), Causal inference, Chapman & Hall/CRC monographs on statistics & applied probability, CRC, с. 70, ISBN 978-1-4200-7616-5

- Julia M. Rohrer. Thinking Clearly About Correlations and Causation: Graphical Causal Models for Observational Data. PsyArXiv (2 июля 2018). doi:10.31234/osf.io/t3qub.

- Ali, R. Ayesha (2012). “Towards characterizing Markov equivalence classes for directed acyclic graphs with latent variables”. Proceedings of the Twenty-First Conference on Uncertainty in Artificial Intelligence (UAI2006): 10—17. arXiv:1207.1365. Дата обращения 14 December 2020.

- Greenland, Sander; Pearl, Judea & Robins, James M. (January 1999), Causal Diagrams for Epidemiologic Research, Epidemiology Т. 10 (1): 37–48, ISSN 1044-3983, OCLC 484244020, PMID 9888278, doi:10.1097/00001648-199901000-00008, <http://www.epidemiology.ch/history/PDF%20bg/Greenland,%20Pearl%20and%20Robins%201999%20causal%20diagrams%20for%20epidemiologic%20research.pdf>

- Pearl, Judea (1986). “Fusion, Propagation and Structuring in Belief Networks”. Artificial Intelligence. 29 (3): 241—288. DOI:10.1016/0004-3702(86)90072-x.

- Pearl, Judea. Probabilistic reasoning in intelligent systems: networks of plausible inference. — Morgan Kaufmann, 1988.